Wie Systeme Künstlicher Intelligenz zu ihren Entscheidungen kommen, blieb Forschern bislang häufig verborgen. Das machte eine Antwort auf die Frage, ob es sich wirklich um intelligente Entscheidungen oder eher um statistisch erfolgreiche Verfahren handelt, unmöglich. Wissenschaftler der Technischen Universität Berlin (TU Berlin), des Fraunhofer Heinrich-Hertz-Instituts (HHI) und der Singapore University of Technology and Design sind dieser Frage nachgegangen und haben bestehende KI-Systeme mit einer speziellen, automatisierten Technologie analysiert und quantifiziert. Die Ergebnisse haben sie bei Nature Communications veröffentlicht.

Den Forschern zufolge zeigen die untersuchten KI-Systeme eine große Bandbreite der gelernten Problemlösungsstrategien: vom naiven Problemlösungsverhalten über Schummel-Strategien bis hin zu hochelaborierten ‘intelligenten’ strategischen Lösungsansätzen. Demnach haben selbst moderne KI-Systeme nicht immer einen aus menschlicher Perspektive sinnvollen Lösungsweg gefunden, sondern bisweilen sogenannte Clever-Hans-Strategien genutzt. Clever Hans – der kluge Hans – war ein Pferd, das angeblich rechnen und zählen konnte und in den Jahren um 1900 als wissenschaftliche Sensation galt. Wie sich später herausstellte, konnte Hans jedoch lediglich in etwa 90 Prozent der Fälle die richtige Antwort aus der Reaktion des Fragestellers ableiten.

Manche KI-Systeme erinnern an den klugen Hans

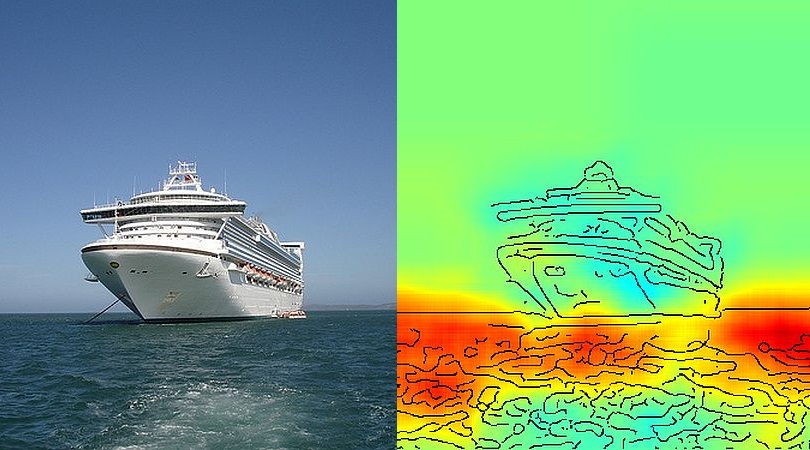

Ähnliche Clever-Hans-Lösungsstrategien fanden die Forscher bei verschiedenen KI-Systemen. So verfolgte ein KI-System, das vor einigen Jahren mehrere internationale Wettbewerbe zur Klassifikation von Bildern gewonnen hat, eine aus menschlicher Sicht naive Lösungsstrategie: Es klassifizierte Bilder vorwiegend anhand des Kontextes. Beispielsweise wurden Bilder der Kategorie ‘Schiff’ zugeordnet, wenn viel Wasser im Bild zu sehen war; bei Schienen im Bild klassifizierte das System das Bild als ‘Zug’. Die eigentliche Aufgabe, nämlich Schiffe oder Züge zu erkennen, hat dieses KI-System nicht gelöst – auch wenn es die Mehrzahl der Bilder im Endeffekt korrekt klassifiziert hat. Diese Art von fehlerhaften Lösungsstrategien nutzen den Forschern zufolge auch einige der neuesten KI-Algorithmen, die sogenannten tiefen neuronalen Netzwerke. Diese würden ihre Klassifikationsentscheidung zum Teil auf Artefakte stützen, die während der Präparation der Bilder entstanden seien und mit dem eigentlichen Bildinhalt gar nichts zu tun hätten.

„Solche KI-Systeme sind für den praktischen Einsatz völlig unbrauchbar. Ihr Einsatz in der medizinischen Diagnostik oder in sicherheitskritischen Bereichen birgt sogar enorme Gefahren“, warnen die Forscher. Es sei durchaus denkbar, dass ungefähr die Hälfte der aktuell eingesetzten KI-Systeme implizit oder explizit solche Clever-Hans-Strategien nutzen. Es sei an der Zeit, das systematisch zu überprüfen, um sichere KI-Systeme entwickeln zu können.

Die Wissenschaftler haben jedoch auch KI-Systeme identifiziert, die unerwartet ‘intelligente’ Strategien gelernt haben und beispielsweise die Atari-Spiele Breakout und Pinball spielen können. Diese KI-Systeme hätten ganz klar das Konzept des Spiels ‘verstanden’ und einen intelligenten Weg gefunden, zielgerichtet und risikoarm sehr viele Punkte zu sammeln.